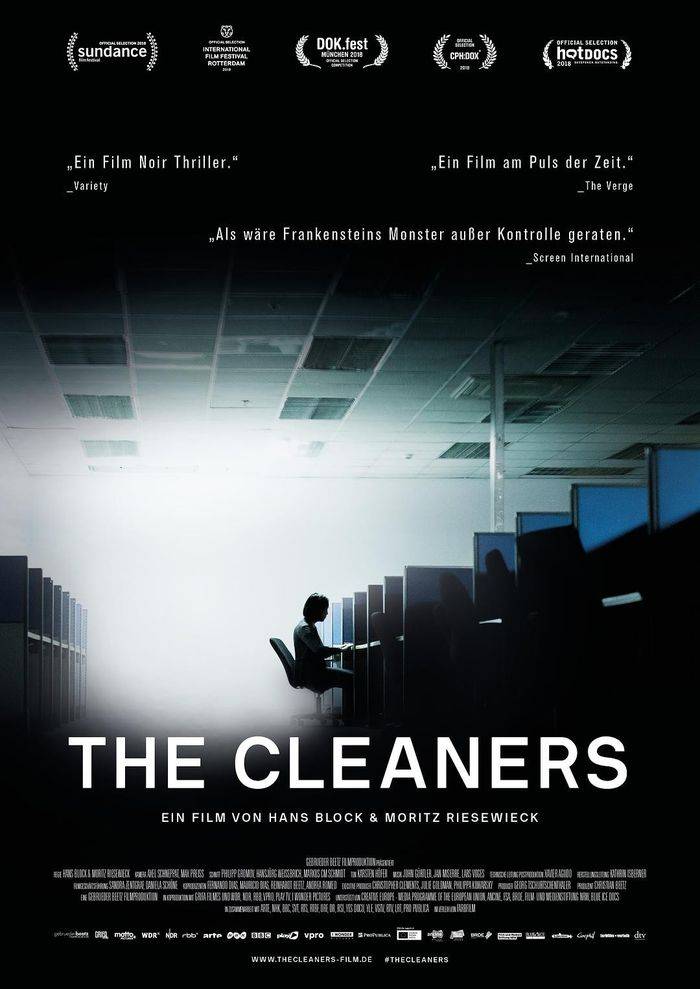

德国纪录片《净网特工 Im Schatten der Netzwelt》介绍

德国纪录片《净网特工 Im Schatten der Netzwelt》(又名《网络审查员》《The Cleaners》)以 “揭秘数字时代的‘信息保洁’行业” 为核心,采用英语中字呈现,分辨率达 1080P,格式为 MP4,文件大小 1.73G。这部纪录片跳出传统科技题材的 “表面叙事”,深入社交媒体平台的 “阴暗幕后”,首次独家披露网络审查作业的真实现状 —— 聚焦脸书等平台中被称为 “清洁工” 的内容审查员,记录他们以秒为单位筛选海量不良内容的日常,同时直面 “内容安全与言论自由” 的全球争议、审查作业对从业者的精神创伤,以及不同文化背景下信息管控的复杂矛盾,兼具纪实深度、社会批判性与人文关怀,让观众重新思考 “谁在控制我们的网络视野” 这一核心命题。

核心定位:网络清洁工 —— 数字世界的 “隐形守门人”

纪录片开篇便颠覆大众对 “网络信息自由流动” 的认知:我们在社交媒体上看到的 “干净内容”,并非自然呈现,而是由一群 “隐形的清洁工” 在幕后筛选、删除的结果。这些审查员多集中在菲律宾等劳动力成本较低的地区,受雇于社交平台或第三方外包公司,每天需处理数以万计的用户上传内容 —— 从色情、暴力、仇恨言论的图片视频,到可能引发社会争议的新闻片段、艺术创作,他们要在几秒内判断 “是否符合平台规则”,并做出 “保留” 或 “删除” 的决定。

正如片中一位菲律宾审查员所说:“大多数人不知道,他们刷到的每一条内容背后,都可能有我们的判断。我们就像数字世界的‘守门人’,但这份工作没有鲜花和掌声,只有源源不断的负面信息和不能言说的压力。” 纪录片的核心,就是让这群 “隐形人” 走到台前,通过他们的视角,揭开网络审查行业的 “光鲜与残酷”—— 它既是维护网络秩序的 “必要手段”,也暗藏着权力管控、文化冲突与人性代价。

内容架构:多维度解构网络审查 —— 从工作真相到全球争议

纪录片以 “审查员的工作轨迹” 为显性脉络,串联起 “行业现状 – 文化矛盾 – 社会争议 – 人性代价” 的多层议题,通过 “实地拍摄 + 人物访谈 + 数据呈现” 的方式,构建完整的叙事链条:

第一部分:审查员的真实工作 —— 高压下的 “秒级判断”

纪录片将镜头对准脸书位于菲律宾的审查据点,还原 “清洁工” 的日常工作场景,展现这份职业鲜为人知的高压与困境:

海量内容的筛选压力:审查员每天需处理数千条用户上传内容,平均每条内容的判断时间不超过 10 秒 —— 屏幕上快速滚动着暴力冲突的现场视频、色情低俗的图片、煽动仇恨的文字,他们必须在极短时间内对照平台给出的 “审查手册”(如 “裸露皮肤超过 50% 需删除”“暴力画面未打码需屏蔽”)做出决定。一位资深审查员透露:“我们有严格的 KPI 考核,每天删除量不达标会被警告,长期不达标会被解雇,所以哪怕看到再恶心的内容,也不能停下滑动鼠标的手。”

严格的保密与心理压抑:平台要求审查员 “严禁向家人、朋友透露工作内容”—— 他们出门前要将工作证锁在抽屉,回家后绝口不提当天看到的画面,甚至不敢向伴侣解释自己为何突然情绪崩溃。纪录片跟踪拍摄一位审查员的私人生活:他下班后会独自躲在房间里喝酒,拒绝与家人交流;睡觉时频繁做噩梦,梦见屏幕上的暴力场景;心理医生诊断他患有 “创伤后应激障碍(PTSD)”,但为了维持生计,他只能继续工作。这种 “身体与心理的双重消耗”,是多数审查员的共同遭遇。

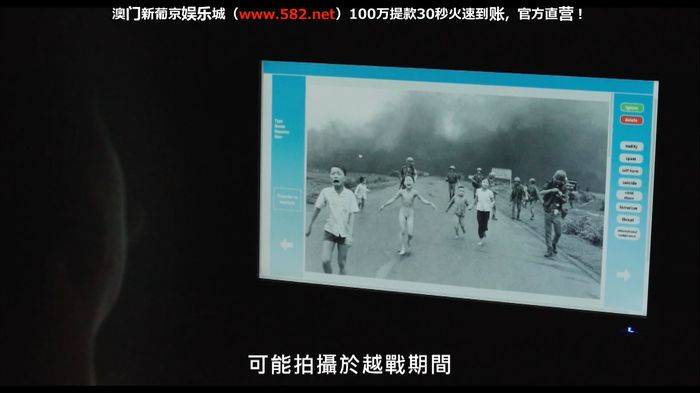

误判与争议的常态:由于审查标准的模糊性(如 “艺术创作与色情的界限”“新闻纪实与暴力传播的区别”),误删事件频发。片中记录了一起典型案例:一位摄影师上传的 “战争难民受伤” 的新闻照片,因画面包含血迹,被审查员判定为 “暴力内容” 删除;一位艺术家发布的 “人体艺术作品”,因裸露身体被误判为 “色情内容” 下架。这些误判不仅引发用户对平台的不满,也让审查员陷入 “自我怀疑”—— 他们不知道自己的 “秒级判断”,是否在无意中扼杀了有价值的信息。

第二部分:审查背后的复杂矛盾 —— 文化、自由与权力的博弈

纪录片并未停留在 “同情审查员” 的层面,而是进一步挖掘网络审查行业的深层矛盾,展现其在全球范围内引发的争议:

文化差异下的审查困境:社交平台的用户遍布全球,但审查标准却难以适配不同文化、宗教与价值观。例如,在中东地区被视为 “亵渎宗教” 的内容(如宗教人物的调侃图片),在欧美国家可能被视为 “言论自由”;在非洲某些部落的 “传统仪式” 视频(包含血腥元素),在其他地区可能被判定为 “暴力内容”。纪录片采访了脸书的审查标准制定者,他们坦言:“我们试图制定‘全球通用规则’,但现实是,同样一条内容,在不同地区的接受度天差地别,稍有不慎就会引发文化冲突。” 这种 “文化适配难题”,让审查工作始终处于 “两难” 境地。

言论自由与内容安全的对抗:随着网络审查的常态化,“威胁表达自由”“助长政治迫害” 的批评声日渐高涨。纪录片记录了多起争议事件:某国家利用社交平台的审查机制,要求删除反对政府的声音;某环保组织的抗议视频因 “涉及敏感话题” 被下架;某记者曝光的企业丑闻片段,被判定为 “恶意传播” 遭屏蔽。这些案例让公众质疑:社交平台的审查权是否被滥用?“删除不良内容” 的边界在哪里?正如一位人权组织成员所说:“我们支持打击网络暴力、色情,但不能接受用‘审查’的名义压制不同声音 —— 今天能删除‘敏感言论’,明天就可能删除‘真相’。”

业余管理者的平台风险:纪录片还指出一个关键问题 —— 社交媒体的 “内容生产与管理” 存在严重失衡:平台的内容主要由普通用户生成(业余创作者),但管理者(审查员)也多为外包的 “非专业人士”,缺乏对新闻伦理、艺术价值、文化背景的专业判断。这种 “业余化管理” 导致平台异常脆弱:既可能因漏删不良内容引发社会风险(如暴力视频诱发模仿犯罪),也可能因误删优质内容错失重要信息(如灾难预警、人权事件曝光),凸显网络信息管控的 “专业性缺失” 危机。

第三部分:谁在控制网络视野 —— 数字时代的权力追问

纪录片的终极追问落在 “信息控制权” 上:当社交平台成为多数人获取信息的主要渠道,“清洁工” 的秒级判断、平台的规则制定,实际上在无形中控制着大众的 “所见所闻与所思所想”。例如,某类社会议题的内容若被大量删除,公众可能误以为该议题 “不存在” 或 “不重要”;某类观点若被频繁推荐,可能引导大众形成 “单一认知”。

纪录片采访了多位互联网研究者,他们指出:“网络审查早已不是‘简单的内容筛选’,而是一种‘隐性的权力运作’—— 平台通过制定规则、培训审查员,间接影响公众的认知边界。这种权力若缺乏监督,可能导致‘信息茧房’加剧,甚至成为某些势力操纵舆论的工具。” 而纪录片的价值,正是通过曝光 “数字保洁业” 的内幕,让这种 “隐性权力” 被看见,推动社会对 “网络信息管控” 的监督与反思。

纪录片的价值与意义

1080P 的高清画质确保了 “工作场景” 的真实呈现:审查员紧盯屏幕的疲惫眼神、办公室里堆积如山的咖啡杯、删除按钮被反复点击的磨损痕迹,每一个细节都传递出这份工作的压抑与沉重;英语中字的设置,准确传达了不同国家审查员、专家、用户的观点,兼顾全球观众的理解需求。

从社会价值来看,纪录片首次系统性揭露网络审查行业的内幕,填补了公众对 “数字信息管控” 认知的空白,推动全球对 “社交媒体责任” 的讨论 —— 平台不应只将审查压力转嫁给底层审查员,而需建立更科学的规则、更专业的团队、更透明的监督机制;从人文价值来看,它关注 “清洁工” 这一弱势群体,展现他们在数字时代的生存困境,呼吁社会重视 “高压职业的心理关怀”,避免将人异化为 “判断机器”;从思想价值来看,它引发对 “言论自由与内容安全”“文化差异与统一规则”“权力监督与平台责任” 等核心议题的深度思考,为数字时代的信息治理提供了 “民间视角” 的参考。

无论是互联网从业者、社会研究者,还是普通网民,都能从这部纪录片中获得启发:它让我们明白,每一次点击 “刷新” 看到的网络世界,都经过了无数人的筛选与判断;而我们在享受网络便利的同时,也需要警惕 “信息被控制” 的风险,主动思考 “我们该拥有怎样的数字空间”。正如纪录片结尾所说:“数字世界的干净,不该只由一群沉默的清洁工用眼泪和创伤换来,而需要平台、用户、社会共同努力,找到‘自由与安全’的平衡。”